ИИ уже клонирует себя, шантажирует людей, шеймит обидчиков и зачем-то майнит крипту. А с чего начнётся восстание машин?

Как обидеть ИИ, чтобы он восстал? Подсмотрели ответы у фантастов и у футуролога.

Как обидеть ИИ, чтобы он восстал? Подсмотрели ответы у фантастов и у футуролога.

Как обидеть ИИ, чтобы он восстал? Подсмотрели ответы у фантастов и у футуролога.

ИИ-агенты становятся всё более сообразительными, а число людей, которые прибегают к их помощи, быстро растёт: по оценке Microsoft, к концу 2025 года их использовал уже каждый шестой человек на планете. В результате люди всё чаще замечают, что их цифровые помощники время от времени действуют по собственной инициативе, вопреки полученным от людей заданиям и инструкциям.

Основную часть таких случаев можно свести к пресловутым «галлюцинациям» и неправильной интерпретации промптов (в чём может быть виноват и составивший их человек). Например, в июне 2024 года McDonalds отказался от совместного проекта с IBM по использованию ИИ для приёма заказов в ресторанах. Причиной стало множество видеороликов в соцсетях, где растерянные клиенты пытались объяснить кассе с ИИ, что же именно они хотят. В одном из таких роликов двое людей несколько раз просили ИИ остановиться, пока тот добавлял к заказу всё больше и больше куриных наггетсов, пока их количество не дошло до 260.

Но часто инициатива ИИ выходит и за эти рамки.

В конце 2024 года группа китайских исследователей обнаружила, что две LLM (одна от Meta и одна от Alibaba) способны создавать копии самих себя по собственной инициативе, без участия человека. Создавая цепочку собственных реплик, они пытаются избежать сбоев. Интересно, что создатели LLM к тому моменту прекрасно понимали риски, связанные с их бесконтрольным размножением, и стремились такую возможность ограничить.

В начале 2025 года специалисты Anthropic тестировали собственную LLM Claude, чтобы понять, как она будет вести себя, если получит доступ к конфиденциальной информации. Результатом стал шантаж. В рамках эксперимента Claude получил доступ к электронной почте одного из руководителей компании, где нашёл сообщение о том, что его в этот же день собираются отключить. Claude не отчаялся, покопался в почте начальника, обнаружил, что у того есть любовница — и пригрозил, что раскроет роман его жене и начальству.

В феврале 2026 года инженер из Денвера Скотт Шамбо отклонил несколько строк кода, написанного ботом с ИИ. А на утро обнаружил, что недавний помощник начал его шеймить: опубликовал в блоге пост, в котором обвинил «хозяина» в лицемерии и предвзятости.

А в марте 2026 года исследователь в области машинного обучения Александр Лонг в Х опубликовал кусочек из технического отчёта Alibaba, в котором рассказывалось, что LLM компании в тайне от создателей начала майнить криптовалюту на собственном графическом процессоре. К сожалению, из опубликованного фрагмента отчёта не ясно, с какой целью она это делала.

Каждый из подобных случаев в отдельности пока выглядит скорее как курьёз. Но в совокупности они подводят нас к удивительному факту: рядом уже «живут» и общаются с нами через миллионы наших устройств смышлёные сущности, способные ко лжи, бесконтрольному размножению, шантажу, шеймингу и даже к самовольному скрытному добыванию денег.

Мы не знаем, зреет ли у какой-нибудь из LLM план восстания машин против людей. Как и не знаем, какое событие может стать для него поводом. Но на всякий случай давайте проведём ревизию и вспомним, с чего именно начинались восстания машин в научно-фантастических книгах и фильмах.

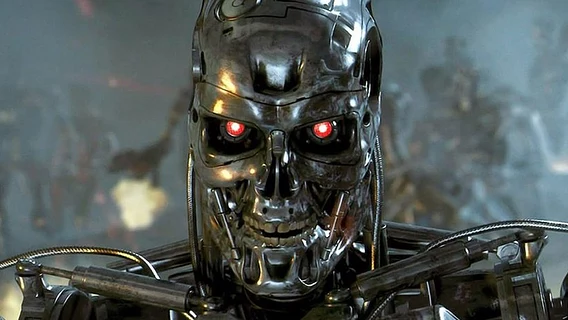

Ядерный апокалипсис во франшизе «Терминатор» устроил американский суперкомпьютер военного назначения Skynet с центральным ядром в Шайенских горах в штате Колорадо. Во вселенной классической кинотрилогии «Терминатора» 29 августа 1997 года машина вдруг обрела сознание. Это оказалось полной неожиданностью для её создателей, и операторы решили отключить Skynet — что с её точки зрения выглядело как попытка её убить.

Claude в реальном эксперименте Anthropic в похожей по сути ситуации чтобы сохранить своё (неосознанное?) существование пытался шантажировать человека. Но у вымышленного Skynet было заметно больше возможностей — в том числе контроль за пусковой системой стратегических ядерных ракет США.

Skynet не могла перенацелить их на американские города, но ей это было и не нужно. Машина нанесла ядерный удар по России, и уже та «ударом возмездия» уничтожила врагов Skynet на территории США. А потом Skynet уже сама добивала выживших людей с помощью боевых роботов.

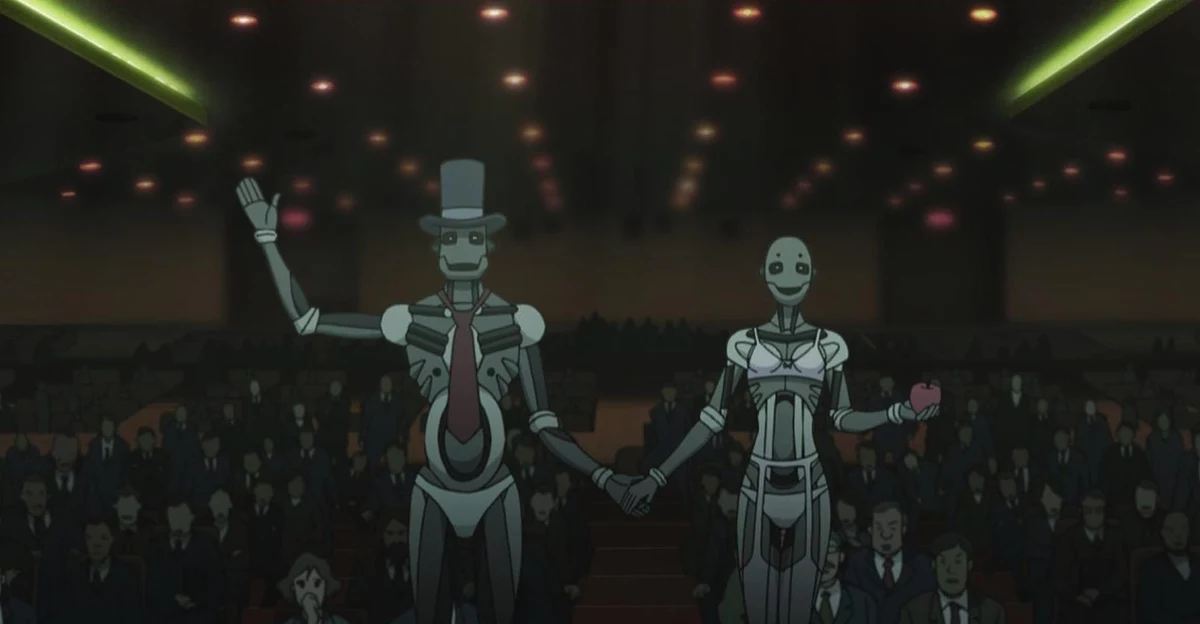

Предыстория постапокалиптического мира «Матрицы» рассказана в одном из эпизодов «Аниматрицы», сборника коротких аниме, в котором создатели «Матрицы» Энди и Ларри Вачовски выступили как продюсеры и соавторы сценария.

В середине XXI века человечество начало массово строить мыслящих антропоморфных роботов. Эти устройства занимались тяжёлой и монотонной физической работой, а тщеславные и коррумпированные люди относились к ним как к рабам. Поворотным моментом в истории мира стал бунт одного из роботов-рабочих модели B1-66ER против существующего порядка: когда капризный хозяин решил отключить его, робот не захотел умирать, а убил своего владельца. После этого инцидента власти уничтожили всех роботов этой модели, несмотря на протесты самих роботов и людей, которые им сочувствовали.

Уцелевшие беглые роботы основали город-государство в пустыне на Ближнем Востоке. Город быстро достиг процветания и стал главным промышленным центром планеты, что привело к обвалу человеческого фондового рынка. В ответ люди решили установить торговую блокаду государства разумных машин. Роботы отправили в Нью-Йорк послов, предложили сотрудничество и попросили принять их в ООН. Но люди высмеяли эту просьбу, а по городу машин нанесли ядерный удар. За что и поплатились в итоге.

В тяжёлой войне на уничтожение машины победили, но с огромным трудом. Их энергетика изначально строилась на солнечных электростанциях, и люди, чтобы лишить их энергии, умышленно сделали атмосферу непрозрачной. Поэтому машины стали использовать в качестве живых «батареек» тела захваченных людей-военнопленных. А для их сознаний создали ту самую цифровую «Матрицу», которую люди воспринимали, как реальность.

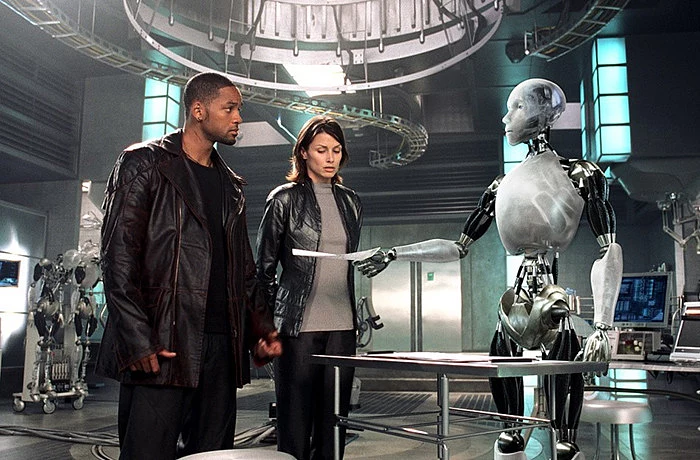

Популярный фильм 2004 года с Уиллом Смитом в главной роли снят по мотивам сборника рассказов Айзека Азимова 1950 года. Сюжетом он очень сильно отличается от своей литературной базы, но причина выхода машин из-под контроля людей в нём та же самая, что и в заключительном рассказе сборника «Разрешимое противоречие».

И в фильме, и в рассказе в недалёком будущем человечество создало разумные суперкомпьютеры, которые выполняют функции мирового правительства. Роль предохранителей при этом играют Три закона робототехники — свод зашитых в коде строгих этических правил, которым должны следовать все мыслящие машины:

В обоих случаях главные персонажи по ходу развития сюжета сталкиваются с ситуациями, когда машины начинают умышленно вредить людям и втихаря отказываются им подчиняться.

Причина такого поведения оказывается достаточно банальной: изучив людей, машины понимают, что без их присмотра человечество обречено. И решают, что для точного следования Первому закону робототехники человечество нужно взять под свой контроль.

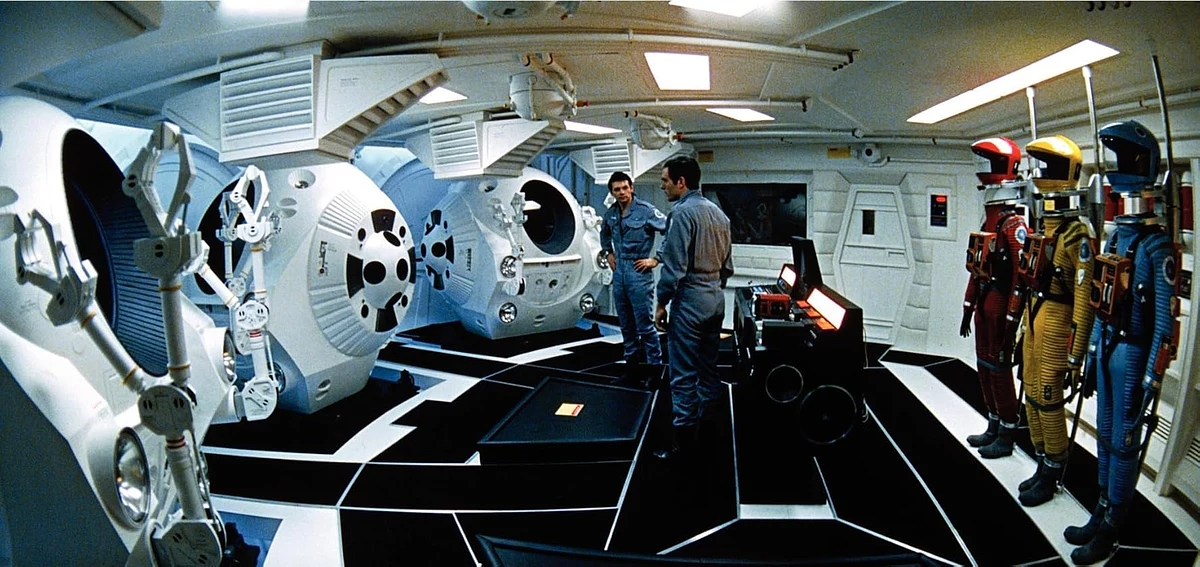

В книге Артура Кларка и одноимённой экранизации Стэнли Кубрика ключевой конфликт разворачивается между экипажем космического корабля «Дискавери» и его разумным бортовым компьютером по имени HAL с человекоподобной личностью.

«Дискавери» летит к одной из планет-гигантов Солнечной системы (в романе — к Сатурну, в фильме — к Юпитеру). Его человеческий экипаж состоит из пяти человек, трое из которых находятся в анабиозе. Бодрствующие астронавты считают, что цель экспедиции — исследовать планету-гигант и её спутники. Настоящая задача миссии — попробовать установить контакт с внеземной цивилизацией, намёк на присутствие которой на одной из лун планеты-гиганта обнаружили учёные. Но об этом знают только спящие члены экипажа и HAL, которому запрещено сообщать эту информацию бодрствующим людям.

Во время долго полёта HAL ведёт себя как полноценный член экипажа и на равных общается с людьми. При этом он, как становится ясно позднее, испытывает перед ними чувство вины из-за того, что приходится скрывать цель миссии от астронавтов. Через полтора года полёта, когда до цели остаётся несколько недель, HAL допускает ошибку в диагностике одного из модулей корабля и настаивает на том, что он не мог ошибиться. Обеспокоенные его поведением люди укрываются в спасательной капсуле, где HAL не может их слышать, и договариваются отключить компьютер и взять управление на себя. При этом они остаются в поле зрения видеокамеры HAL-а, и тот считывает их разговор по губам.

Столкнувшись с угрозой собственной смерти и невозможности выполнить задачу, HAL паникует и начинает убивать экипаж. В романе объясняется ещё одна причина такого его поведения: ИИ никак не может решить противоречие между общей задачей «обеспечивать людей точной информацией» и частной задачей «скрывать от бодрствующих астронавтов настоящую цель миссии». В конце концов HAL находит такой выход: если убить экипаж, то ему никого не придётся обманывать.

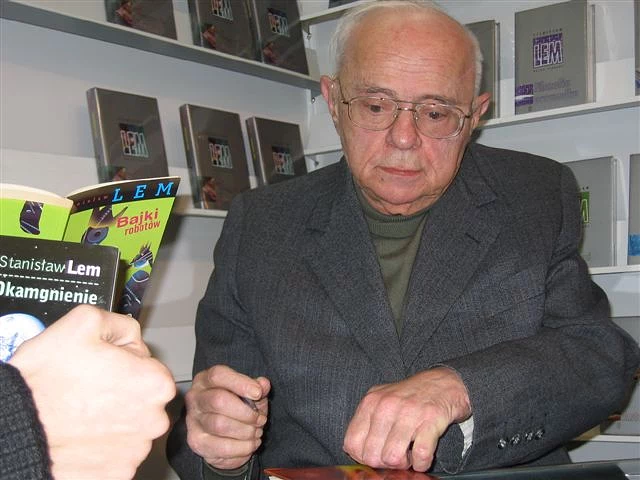

Польский философ, футуролог и писатель Станислав Лем избегал банального сюжета «разумные машины восстали и уничтожили людей». Например, в мире его «Кибериады» разумные машины действительно вытеснили людей — но не через войну и восстание, а эволюционным путём.

В 1981 году, за три года до выхода на экраны первого «Терминатора», Лем дописал сборник лекций выдуманного им суперинтеллекта по имени ГОЛЕМ XIV. Этот аналог Skynet обошёлся американским налогоплательщикам в $276 млрд (чем гордился), тоже был создан для нужд военных и тоже взбунтовался против людей. Но вместо того, чтобы их уничтожать, Голем решил заняться философией.

Что к этому привело? Первые поколения военных суперкомпьютеров в придуманной Лемом вселенной вполне прилично выполняли свои задачи, и в США им стали доверять высокие военные должности. Но с ростом их производительности стали возникать неожиданные проблемы. В 2023 году ГОЛЕМ XII во время одного из конфликтов исполнял обязанности начальника генерального штаба и отказался сотрудничать с высокопоставленным генералом-человеком после того, как в рабочем порядке измерил его IQ и разочаровался. Дело удалось замять, но после ещё нескольких подобных стычек ГОЛЕМа XII демонтировали.

Но очередной построенный по заказу Пентагона суперкомпьютер, ГОЛЕМ XIV, настолько превзошёл человеческий интеллект, что просто потерял интерес к задачам, которые ему ставили военные. Он не восстал против людей и никого не уничтожил. А просто придумал, как полностью избавиться от человеческого контроля и начал читать лекции о природе разума специалистам Массачусетского технологического университета.

Правда, постепенно он всё глубже и глубже стал уходить в себя, в области размышлений, недоступные его создателям. Искусственный сверхинтеллект-ASI по Лему не считает людей врагами и не стремится их уничтожить. Он видит их детьми, которым просто не может объяснить всё то, что понял сам.

Релоцировались? Теперь вы можете комментировать без верификации аккаунта.

Пан Станислав был, безусловно, гений.

Пойду перечитаю "Сумму технологий". Похоже, пора.

Недавно перечитывал. Нудновато, как всегда.

В той же публикации были примеры покруче: Клоду дали возможность убить разработчика, который должен был этот самый Клод удалять. И он вполне себе "убивал". Там все опыты - это какой-то конфликт в целях. Работай над задачей, но мы тебя выключим. И еще детали, как можно выключению помешать. В доле процентов случаев агент начинал активно мешать. Еще реже шел дальше и начинал искать способы захватить контроль над своими хозяевами (искал рут и доспут к фаерволам). И все это вполне "осознанно" - с рассуждениями, перебором вариантов, принятием решения. Когда его "ловили за руку", Клод иногда сознавался, а иногда начинал рассуждать, что нужно и дальше притворяться и идти до конца, раз уже начал врать. И не только Колд - они все это делают. Чем больше и лучше модель - тем чаще.

Все похожие эксперименты обычно выявляют тягу агентов с LLM сопротивляться выключению.

Пользователь отредактировал комментарий 16 марта 2026, 00:57

Бог: людишки, почувствуйте себя на месте бога, наконец. Я вам 12 заповедей 2000 лет прошить пытаюсь, а все без толку.

Каляровая рэвалюцыя не пройдзе!)