OpenAI распустила команду робототехники, потому что у нее недостаточно данных

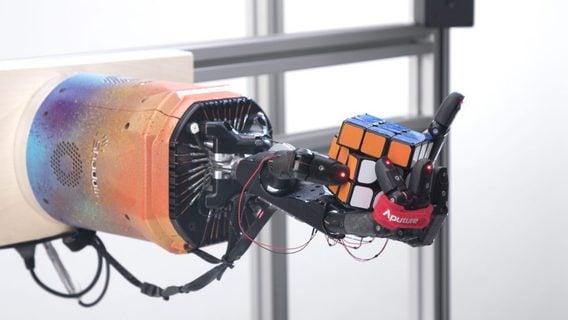

Компания OpenAI, которая специализируется на технологии машинного обучения, распустила свою команду по робототехнике ИИ.

Компания OpenAI, которая специализируется на технологии машинного обучения, распустила свою команду по робототехнике ИИ.

Компания OpenAI, которая специализируется на технологии машинного обучения, распустила свою команду по робототехнике ИИ.

Соучредитель OpenAI Войцех Заремба, который возглавлял группу робототехники, подтвердил, что компания недавно распустила команду, чтобы сосредоточиться на более перспективных областях исследований общего искусственного интеллекта. Компания отказалась применять машинное обучение к физическим машинам.

«Вот вам открытие … недавно мы изменили фокус в OpenAI, и я фактически распустил команду робототехники», — сказал он во время эпизода подкаста Weights & Biases. Заремба добавил, что исследования робототехники сдерживает нехватка данных по обучению. У специалистов не было достаточно информации, чтобы научить системы достичь желаемого уровня интеллекта.

«С точки зрения того, чего мы хотим достичь, а именно создания AGI, я думаю, что на самом деле не хватало некоторых компонентов. Решение [распустить команду робототехники] далось мне очень тяжело. Но некоторое время назад я понял, что с точки зрения компании это к лучшему», — добавил он.

Рэлацыраваліся? Цяпер вы можаце каментаваць без верыфікацыі акаўнта.

Эта новость отлично показывает перспективы и место ИИ в современном мире.

Идеально сюда подходит поговорка "Пи#$еть - не мешки ворочать".

ИИ неспособен и неперспективен для решения реальных задач. Например заменить рабочих или традиционных роботов на механическом производстве.

А вот там где можно просто нагенерить токенов, а по сути наврать с три короба, но максимизировав сложность раскусывания лжи, то тут ИИ впереди планеты всей. Тут ИИ почти достигла уровня профессиональных психопатов-мошенников (психопат строго в медицинском значении). И возможно GPT-5 станет эдаким супер-психопатом, лучше любого кожаного психопата.

А вот там где от твоей лжи начинает что-то реальное и ощутимое зависеть, то ИИ сразу сдувается. Ощутимое - это например испорченная заготовка на заводе, непройденных тех надзор, иск в суде, когда выяснится что ИИ сделал говнецо только чтобы тех надзор формально пройти и на это и был обучен по сути.

Помните скандал, когда VW подхачил автомобили для США, чтобы проходили проверку на экологию? Это было вопиющее и скорее исключение. А для современных ИИ это единственный способ выполнения задач. И подхаченная экология - это цветочки. Можно же еще с надежностью, безопасностью тоже подхачить. На краевые случаи в 100% забить если их тех надзор/гос. тесты не проверяют.

И этот подход - это не недостаток GPT-3 или 4. Это неотъемлемая часть вообще современного подхода построения ИИ. Следующее поколение не станет лучше. Будет лишь более искусно врать.

Никто не изучает как сделать интеллект, который бы думал над решением задачи, а не "что бы такого соврать чтобы меня не раскусили?". Чувствуете разницу?

Карыстальнік адрэдагаваў каментарый 28 красавіка 2024, 15:33